O Deus-máquina: o propósito e os desafios éticos da IA

Cientistas questionam abordagem ideológica da inteligência artificial e narram disputa de ego

Em 2020, uma petição reuniu a assinatura de mais de 1,5 mil profissionais do Google e mais de 2,2 mil acadêmicos e membros da sociedade civil questionando a demissão de uma cientista e pesquisadora da área de inteligência artificial. Tratava-se de Timnit Gebru.

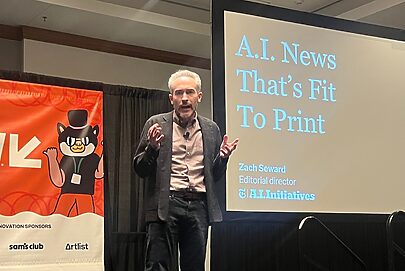

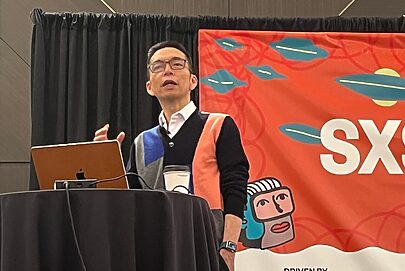

John Palfrey, Timnit Gebru e Karen Hao no SXSW 2026 (Crédito: Taís Farias)

O caso aconteceu após Gebru enviar um e-mail interno em que acusava o Google de silenciar vozes marginalizadas. Isso porque a empresa pediu que a pesquisadora se retratasse ou retirasse seu nome e de outros colegas de um artigo acadêmico sobre potenciais riscos éticos dos modelos de linguagem em IA.

Na época, Jeff Dean, então líder de IA do Google, afirmou que o trabalho tinha “lacunas importantes que os impediam de ficar confortáveis ao relacioná-lo ao Google”. Em 2023, Dean foi nomeado cientista-chefe do Google após a fusão entre DeepMind e Google Brain que deu origem ao Google DeepMind.

Já Gebru, após a saída do Google, criou seu próprio centro de pesquisa em IA, o Distributed AI Research Institute. Ela também cofundou a organização sem fins lucrativos Black in AI, que trabalha para aumentar a presença, inclusão e visibilidade de pessoas negras na inteligência artificial.

Ao lado da jornalista e autora do livro “O império da IA”, Karen Hao, ela debateu os desafios éticos da evolução da inteligência artificial. Para as especialistas, as empresas do Vale do Silício vêm disseminando a pauta da inteligência artificial geral (AGI), mas não existe um propósito ou objetivos claros de como essa tecnologia pode apoiar as pessoas.

“Não deveríamos perguntar, primeiro, quais são os objetivos que estamos tentando alcançar e, então, projetar quais tecnologias podem nos apoiara? Em vez de simplesmente avançar com a IA pela própria IA e deixar que isso comece a causar um enorme efeito dominó, como a automação dos empregos”, questiona Hao, que investiga o impacto da IA na sociedade.

Gebru citou uma entrevista em que Ilya Sutskever, cofundador e ex-cientista chefe da OpenAI, afirmava que, no futuro, a própria inteligência artificial poderia responder sobre ética.

“Eu não entendo como engolimos essa narrativa. É assim que eles estão justificando todo o consumo de recursos, toda a exploração de mão de obra e o roubo de dados. Porque, se vamos construir o ‘deus-máquina’ que vai consertar tudo para nós, claramente deveríamos usar todos os recursos da Terra. E, se os recursos da Terra acabarem, deveríamos ir para o espaço e minerar Marte. É isso que estamos aceitando. Esse é o argumento lógico”, defendeu a cientista.

Para a criadora do Distributed AI Research Institute, na ambição de criar modelos cada vez mais abrangentes, a discussão sobre a tecnologia saiu do campo científico e migrou para o campo ideológico.

“No Google, viram que a OpenAI estava ganhando muita mídia por construir um modelo grande e o pessoal dizia: ‘Por que não somos nós que estamos construindo o maior modelo?’. E eu questionava: ‘Por que nos importamos em construir o maior o que quer que seja? O que estamos tentando resolver?’. Parecia uma disputa de ego”, descreve Gebru.

Infância e a IA

A cientista conta que, recentemente, prestou depoimento em um processo contra a Character.AI e o Google. O processo em questão terminou em janeiro deste ano quando as empresas chegaram a um acordo com as famílias que alegavam que os chatbots tinham causado danos psicológicos em crianças e adolescentes.

Um dos casos é o de Megan Garcia, que processou a Character.AI e o Google após o suicídio de seu filho. “Meu conselho para os pais é: realmente, tenham muito cuidado com seus filhos e esses chatbots, porque estamos apenas começando a entender os efeitos das redes sociais e sinto que isso é ainda pior. É altamente viciante”, ponderou a ex-funcionária da big tech.

Rana El Kaliouby, cofundadora da startup de IA Affectiva e pesquisadora de expressão e emoção na tecnologia, propõe um senso de responsabilidade compartilhado.

“Ao pagar a assinatura de US$ 20 dólares por mês, todos nós estamos escolhendo e acho que devemos fazer perguntas como: essa empresa se importa com a ética da tecnologia? Como ela está sendo construída? Eles estão pensando em vieses, tanto nos dados quanto nos algoritmos? Estão pensando em confiança, segurança e privacidade? Estão pensando nos casos de uso dessa tecnologia? Onde ela deve ser implementada e onde realmente não deveria?”, questiona Kaliouby.