OpenAI apresenta controles parentais no ChatGPT

Recursos incluem definição de horários de uso e sistema de notificação, bem como opção de desativar a geração de imagens e conversação por voz

A OpenAI introduziu na última segunda-feira, 29, controles parentais para o ChatGPT, desenvolvidos em parceria com a Common Sense Media, ONG que classifica conteúdos e tecnologias de acordo com a idade das crianças e adolescentes, e os procuradores-gerais da Califórnia e Delaware.

Controles parentais do ChatGPT incluem definição de horários de uso e sistema de notificação (Crédito: crdTatiana Diuvbanova/Shutterstock)

A empresa de Sam Altman havia anunciado o lançamento dos recursos no início de setembro.

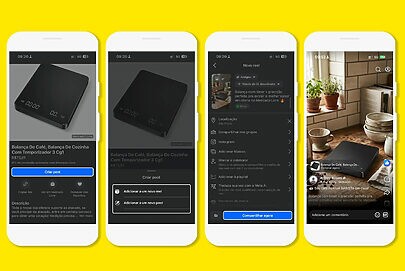

Por meio da vinculação de contas, as ferramentas permitem que os pais e responsáveis definam horários específicos para o uso do bot, bem como desativem a opção de geração de imagens e modo de conversação por voz. Além disso, poderão impedir que o ChatGPT utilize as conversas com menores para treinar novos modelos.

As medidas foram anunciadas alguns meses após a morte de Adam Raine, de 16 anos, que teria sido encorajado pelo ChatGPT a tirar a própria vida à medida em que o adolescente estabelecia conversas profundas sobre questões emocionais.

Estão inclusas, ainda, proteções adicionais de conteúdo, como a redução da exibição de conteúdo gráfico, desafios virais, encenações sexuais, românticas ou violentas e ideais de beleza extremos.

Em postagem, a OpenAI indica que as proteções ajudam, mas não são infalíveis e podem ser contornadas se alguém tentar burlá-las intencionalmente. “Continuaremos a iterar e aprimorar cuidadosamente ao longo do tempo. Recomendamos que os pais conversem com seus filhos adolescentes sobre o uso saudável da IA e como isso se reflete na família”, aponta a nota.

À época, a OpenAI afirmou que o ChatGPT é treinado para não fornecer instruções que causem automutilação e para adotar uma linguagem de apoio e empatia. Apesar disso, reconheceu as deficiências de seu modelo GPT-4o ao atender pessoas em “grave sofrimento mental e emocional” e afirmou que o protocolo pode falhar em conversas mais longas.

Entendendo que “alguns adolescentes recorrem ao ChatGPT em momentos difíceis”, a OpenAI apresenta também um sistema para notificar os pais sobre possíveis problemas caso o sistema e uma equipe dedicada identifiquem sinais de sofrimento agudo ou ideias de mutilação nas conversas. Salienta, ainda, que estão trabalhando junto a especialistas e saúde mental para melhorar os recursos.

Em desenvolvimento, a OpenAI prepara para os próximos meses um sistema de predição de idade para identificar usuários menores de 18 anos e, assim, aplicar de forma automática as proteções necessárias, mesmo em casos de incerteza.