Em ano de eleições, SXSW discute impacto da IA na democracia e regulamentação

Evento convida Amazon e OpenAI para discutir avanços da IA, mas também pauta viéses algorítmos, regulamentação e impacto da IA nas eleições

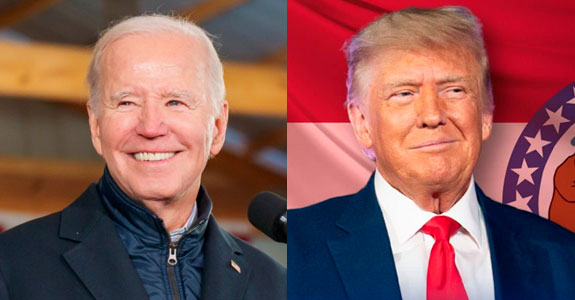

Às vésperas das primárias da eleição presidencial dos Estados Unidos, começou a circular na internet uma deepfake produzido com auxílio da inteligência artificial que aludia a uma gravação com a voz de Joe Biden, concorrente à reeleição, pedindo aos membros do Partido Democrata para ficarem em casa e não participarem das primárias do partido. No ano anterior, Biden também foi vítima de outro deepfake, desta vez em vídeo, em que o presidente assediava sua neta. Outros políticos, como Donald Trump, que também compete nas primárias pelo Partido Republicano, também são alvos de conteúdos produzidos com IA, como imagens que simulam sua prisão, por exemplo.

SXSW discute impactos da inteligência artificial nas eleições durante prévias dos partidos democrata e republicano (Crédito: Divulgação)

Nesse cenário, Austin, que é majoritariamente democrata em um estado predominantemente republicano (também descrita como “o ponto azul em um oceano vermelho”), se prepara para sediar mais uma edição do South by Southwest (SXSW).A programação do SXSW aumenta a presença de agentes políticos em sua programação do conference.

Em ano de eleição presidencial, a democracia ganhou mais espaço. São oito painéis com a palavra democracia no título. Outros tantos abordam o tema em discussões sobre as leis eleitorais, reforma da justiça criminal, o impacto da IA no jornalismo, o futuro da internet, entre outros. Os que colocam a democracia como chamariz debatem o uso de urnas, ativismo LGBTQ em intersecção com a crise na democracia, medidas de proteção ao sistema eleitoral e à integridade digital do cidadão, iniciativas para atuação participativa na proteção da democracia, ascensão da censura a livros, e, finalmente, a relação entre a democracia e as eleições com o tema do ano: inteligência artificial.

Já que na edição de 2023, IA esteve na boca da maioria, senão de todos os painéis – a própria organização correu atrás de incluir sessões especialmente sobre o tema semanas antes do início do evento -, neste ano o SXSW decidiu dar uma track própria à tecnologia. Amazon, Google e OpenAI estarão presentes para apresentar os avanços da ferramenta na qual investem.

SXSW aborda impacto da IA na democracia

Algumas palestras trarão perspectivas sobre o futuro da IA e suas possibilidades no trabalho e na criatividade, mas outra parte das conversas será centrada em responsabilidade e regulamentação da IA. Essa parcela inclui discussões com a head da Federal Trade Commission, Lina Khan, sobre regulamentação da IA e de big techs, com a Dra. Joy Buolamwini, da Algorithmic Justice League, especialista em vieses da IA, e trocas a respeito dos impactos da IA em direitos humanos, os limites éticos da tecnologia, sistemas transparentes para proteção de dados e reflexões sobre o modelo adotado pela FTC ao tentar restringir a IA, o denominado “model deletion”, no qual exige que as empresas excluem modelos que usam dados obtidos de forma ilícita.

Uma das sessions que aborda o tema é da brasileira Yasodara Córdova, pesquisadora-chefe em Privacidade da idtech Unico, e bolsista no Digital Kennedy School, do Belfer Center de Harvard, membra do Berkman Klein Center for Internet and Society, também de Harvard, bolsista do Ash Center for Democratic Governance e parte do grupo de pesquisa Digital Trust, do Fórum Econômico Mundial (WEF). Em “Privacy and AI: Taking Back Control Of Our Data”, a executiva irá detalhar o valor dos dados enquanto matéria-prima para grandes empresas e como pensar um futuro com maior controle e privacidade de dados em um cenário em que as plataformas de IA dependem dessas informações.

Yasodara foi painelista em 2023 e considera o SXSW promotor de discussões diversas, que envolvem, também, política (Crédito: Divulgação)

Yasodara vê o SXSW como um espaço para trocas diversas e abertas, o que acaba resultando em conversas sobre política, já que a disciplina determina o futuro dos negócios e da sociedade, como um todo. “O SXSW é um espaço de troca de ideias, onde a arte, criatividade e tecnologia caminham juntas para pensar o futuro. As palestras tendem a trazer várias perspectivas e incentivar conversas em torno da política e da tecnologia de maneira muito aberta, sem que isso cause celeuma entre os convidados. O resultado é que o evento acaba por pautar acontecimentos e debates durante todo o ano. O SXSW também é de negócios e, por causa disso, a política entra como prioridade, e as causas acabam mostrando os benefícios de uma política ética de maneira muito tangível”, divide.

Contexto traz desconfiança

A eleição presidencial dos Estados Unidos deste ano é a primeira desde a popularização da inteligência artificial a partir do ChatGPT, da OpenAI, e a primeira a sentir os primeiros efeitos do Sora, IA que transforma textos em vídeos, da mesma empresa. Embora a IA tenha influenciado eleições anteriores, por sua capacidade de automação, nos últimos cinco anos, a tecnologia ganhou escalar e novas habilidades, como o processamento de áudio e vídeo, formatos que têm potencial de credibilidade grande, afirma Leandro Tessler, professor da Unicamp e gestor científico de educação e difusão do conhecimento no Centro de Pesquisa em Inteligência Artificial – Brazilian Institute of Data Science (BI0S). Conforme o professor, um áudio pode usar emulações de uma voz e, mesmo que ela não seja a voz correspondente a uma figura pública, a similaridade faz com que o ouvinte preencha lacunas e assuma que a voz seja de um político.

Ronaldo Lemos considera que as big techs fazem avanços em prol da autoregulamentação (Crédito: Thaís Monteiro)

Por sua vez, o vídeo criado por IA vem colocar a pá de cal para a crença de que imagens comprovam um fato. Segundo o advogado e diretor do Instituto de Tecnologia e Sociedade do Rio de Janeiro, Ronaldo Lemos, os vídeos eram considerados a prova mais confiável de que algo aconteceu. Hoje, é necessário desconfiar inclusive deles. Para além do conteúdo final, a tecnologia auxilia no conhecimento profundo de quem é o potencial eleitor e ajuda no direcionamento de mensagens. Lemos esteve presente no SXSW de 2023, quando Greg Brockman, co-fundador e presidente da OpenAI, afirmou que a moderação de conteúdo iria acabar com a existência da IA, por sua alta capacidade de monitoração. Hoje, a própria empresa implementa selos de identificação para conteúdos produzidos com suas ferramentas.

Os avanços da tecnologia vão de encontro a um cenário político polarizado em um ano de diversas eleições. No sistema bipartidário ou em situações polarizadas, o poder da influência da IA é potencialmente maior, já que muitas vezes a diferença percentual entre dois candidatos é próxima. “O voto hoje, do jeito que temos, incentiva a polarização. As eleições são decididas por 51 a 49. É uma divergência muito grande. Eu queria enxergar os 40% que estão no meio, criar mecanismos para fazer com que esse meio do caminho possa ser expresso”, avalia Lemos. Para o advogado, as regulações retomam a possibilidade da sociedade exercer o poder de síntese, ou seja, restringir a produção de conteúdo falso que alimenta a polarização e as antíteses entre ideias e extremos.

Além da americana, a Indonésia, Índia e México sediam eleições presidenciais. O Reino Unido tem eleições para o Legislativo e o Brasil elege prefeitos e vereadores. Segundo o World Economic Forum, 83 eleições estão agendadas ao redor do mundo neste ano, sendo essa a maior concentração esperada nos próximos 24 anos. Desses, 40 elegem líderes do governo. Membro do fórum, Yasodara compartilha que a organização se divide entre considerar cedo para regulamentar a IA e tarde para evitar que deepfakes e outras técnicas do uso de IA sejam usadas estrategicamente por candidatos, criando narrativas que despertam sentimentos instintivos, como o medo.

Regulamentação em pauta no SXSW

A preocupação aparece também do lado das big techs, que em 16 de fevereiro firmaram um acordo para detectar e combater notícias falsas geradas por IA nas eleições do ano. Além de fazer a parte de controle, as empresas irão impulsionar campanhas educativas para sensibilizar o público sobre o problema e fomentar a transparência. Nas 20 empresas participantes da iniciativa, estão Adobe, Amazon, Google, IBM, Meta, Microsoft, OpenAI, TikTok e X (antigo Twitter).

O contexto influencia diferentes players, que buscam mitigar os efeitos das IAs nas eleições. Iniciativas públicas e privadas se propõe a identificar vídeos, textos e imagens falsas, mas o cenário pressiona os órgãos públicos a pensar em políticas de regulamentação para a tecnologia, seja no reforço de leis anteriores ou na criação de novos marcos regulatórios. Nos Estados Unidos, não é diferente. “A falta de controle sobre a tecnologia desperta discussões sobre a soberania dos países, a regulação e a estabilidade global. Isso tudo vai servir de combustível para as eleições nos Estados Unidos e sua capacidade tanto de controlar as IAs quanto de influenciar o uso de tecnologias como essa globalmente”, comenta a executiva da Unico.

No final de outubro de 2023, o presidente dos Estados Unidos, Joe Biden, fez pronunciamento público e assinou a primeira ordem executiva para regulamentar a IA no país. Biden afirmou que é necessário “governar a tecnologia”. A ordem executiva do presidente dos EUA prevê que desenvolvedores compartilhem os resultados de testes de segurança, se submetam aos padrões de testes do Instituto Nacional de Padrões e Tecnologia (NIST) antes do lançamento dos sistemas e adotem marca d’água identificatória para conteúdo criado por IA. A ordem ainda prevê legislação bipartidária de privacidade de dados e relatório para identificar potenciais riscos da IA no mercado de trabalho. Antes disso, em julho, Google, Meta, OpenAI e outras big techs assinaram compromisso com o governo americano para implementar medidas que identifiquem o conteúdo gerado por IA.

Já a Comissão Federal de Comércio (FTC) exige que empresas excluam modelos que usam dados obtidos de forma ilícita. Em janeiro deste ano, o órgão antitruste abriu uma investigação sobre os investimentos de big techs em startups de IA para compreender como tais parcerias aumentam o poder das empresas como Amazon, Microsoft e Google e influenciam a concorrência. “Nosso estudo esclarecerá se os investimentos e parcerias realizados por empresas dominantes correm o risco de distorcer a inovação e prejudicar a concorrência justa”, disse a presidente da FTC, Lina Khan, em comunicado. Lina é entrevistada no SXSW em um painel que abordará regulamentação da IA, big techs e a relação entre o antitruste e inovação.

Segundo Yasodara, os estados contam com leis que regulam o machine learning em campanhas eleitorais e o Texas tem uma regulação de 2019 que proíbe a publicação de vídeos deepfake para prejudicar um candidato ou influenciar uma eleição nos 30 dias que antecedem a eleição. Porém, a legislação não cobre os avanços da tecnologia nos últimos anos. “A promessa é de que o Texas reforce a regulação com medidas mais duras, inclusive para as big techs. Outro assunto que ressurge é a questão da privacidade. Os EUA ainda não têm uma lei geral para privacidade e há tensões entre estados, pois uns aprovaram leis mais permissivas enquanto outros são mais duros com essa questão”, relata.

Porém, na avaliação de Tessler, os EUA é um país com menos controle e regulação em detrimento do modelo econômico, que busca privilegiar o desenvolvimento tecnológico e econômico das empresas nacionais. “A regulamentação dos EUA deve seguir na direção da transparência, mais do que na direção de limitar o que pode ser feito”, divide. “A impressão que dá é que nos países da Europa, a discussão se dá um pouco mais dentro das esferas políticas do que nos EUA. Nos Estados Unidos, acontecem em círculos de cidadania, lobbies, think tanks, etc”, compartilha.

Empresas aderem a autoregulamentação

Enquanto uma legislação sobre o caso não ganha as ruas, as próprias desenvolvedoras se esforçam no sentido da auto-regulamentação. O Bing, da Microsoft, já não permite a criação de vídeos com políticos. A Meta e a OpenAI desenvolvem mecanismos para identificar os conteúdos criados com auxílio das suas ferramentas. Tais iniciativas envolvem brechas. “O problema são os usos maliciosos. Os selos podem ser removidos. Pode ter gente que crie imagens de forma maliciosa na véspera das eleições para causar algum tipo de impacto e para promover violência. Isso é muito problemático, porque o dano é imediato.”, opina Lemos.

“É preciso compreender que a regulação não conseguirá abordar todos os riscos e impactos do uso ‘indevido’ da IA. Ela deve, idealmente, trazer princípios e premissas que orientem as empresas a desenvolverem a tecnologia de forma segura. Estabelecer uma definição de IA e, portanto, do escopo da regulamentação, que acomode a dinamicidade da tecnologia e que também não iniba o seu desenvolvimento nos países mais avançados nesse debate, parece ter sido um desafio importante até o momento. Nessa linha, garantir que a regulação de um país/bloco econômico não impeça a interoperabilidade da tecnologia também é necessário para que não levantem barreiras técnicas à importação/exportação dos serviços criados a partir de tais tecnologias”, compartilha Diana Troper, Data Protection Officer da Unico.